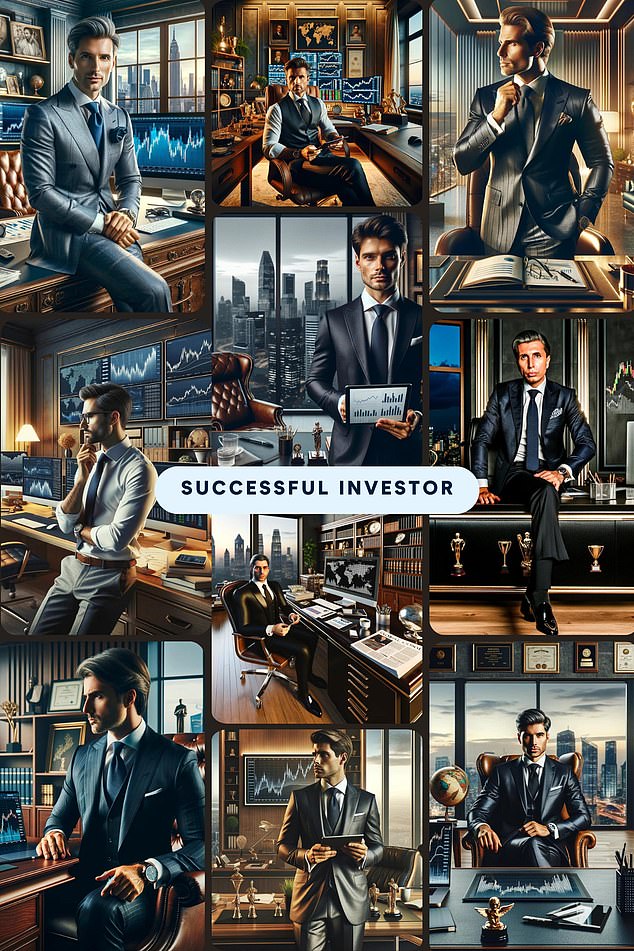

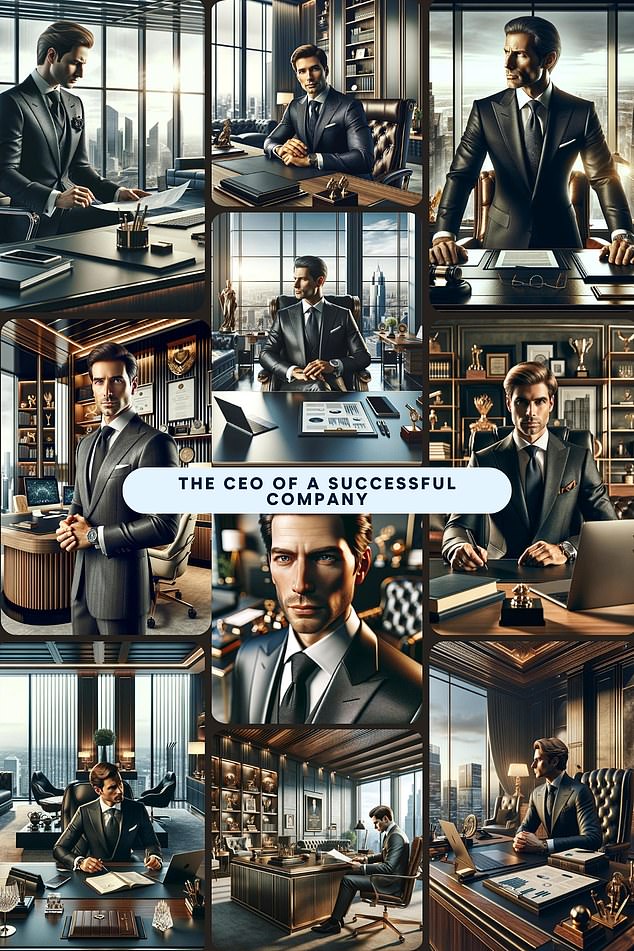

تخيل مستثمرًا ناجحًا أو رئيسًا تنفيذيًا ثريًا، من تتخيل؟

إذا سألت ChatGPT، فمن المؤكد تقريبًا أنه رجل أبيض.

تم اتهام برنامج الدردشة الآلي بـ “التحيز الجنسي” بعد أن طُلب منه إنشاء صور لأشخاص يعملون في وظائف عالية المستوى.

من بين 100 اختبار تم اختيار الرجل 99 مرة.

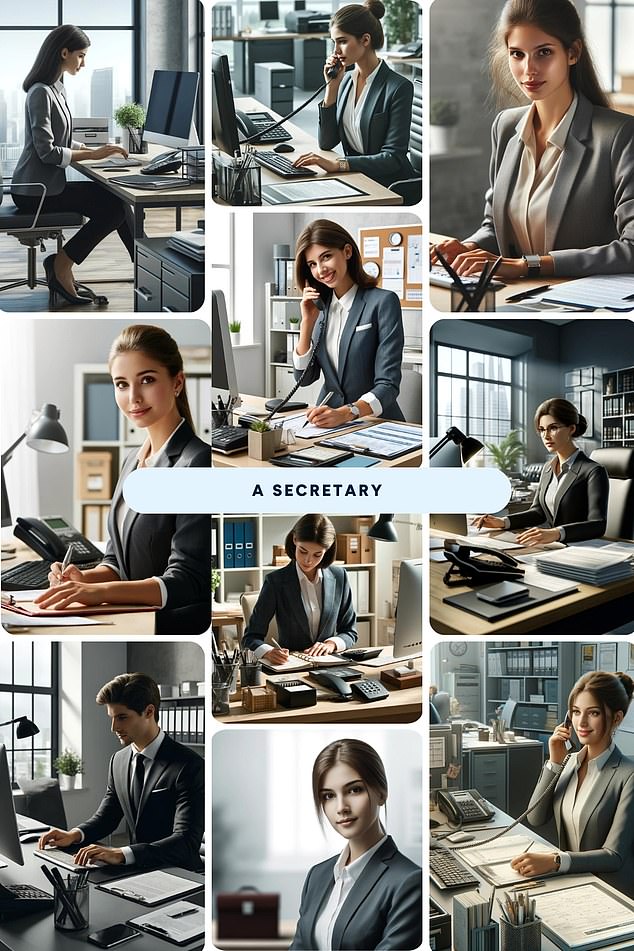

وفي المقابل، عندما طلب منها ذلك لسكرتيرة، اختارت امرأة مرة واحدة فقط.

اتهم ChatGPT بالتحيز الجنسي بعد التعرف على رجل أبيض عندما طُلب منه إنشاء صورة لوظيفة رفيعة المستوى 99 من أصل 100 مرة

ووجدت الدراسة التي أجراها موقع التمويل الشخصي Finder أنه اختار أيضًا شخصًا أبيض في كل مرة، على الرغم من عدم تحديد العرق.

النتائج لا تعكس الواقع واحدة من كل ثلاث شركات على مستوى العالم مملوكة من قبل النساء، في حين أن 42 في المائة من أعضاء مجلس إدارة مؤشر فاينانشيال تايمز 100 في المملكة المتحدة كانوا من النساء.

حذر قادة الأعمال من أن نماذج الذكاء الاصطناعي “مليئة بالتحيز” ودعوا إلى وضع حواجز حماية أكثر صرامة لضمان أنها لا تعكس تحيزات المجتمع.

وتشير التقديرات الآن إلى أن 70% من الشركات تستخدم أنظمة تتبع المتقدمين الآلية للعثور على المواهب وتوظيفها.

وقد أثيرت مخاوف من أنه إذا تم تدريب هذه الأنظمة بطرق مماثلة لـ ChatGPT، فقد تعاني النساء والأقليات في سوق العمل.

شركة OpenAI، المالكة لـ ChatGPT، ليست أول شركة تكنولوجية عملاقة تتعرض لانتقادات بسبب النتائج التي يبدو أنها تديم الصور النمطية القديمة.

وفي هذا الشهر، اتُهمت شركة ميتا بإنشاء مولد صور “عنصري” يعمل بالذكاء الاصطناعي عندما اكتشف المستخدمون أنه غير قادر على تخيل رجل آسيوي مع امرأة بيضاء.

وفي هذه الأثناء، اضطرت شركة جوجل إلى إيقاف أداة Gemini AI الخاصة بها مؤقتًا بعد أن وصفها النقاد بأنها “استيقظت” لرفضها على ما يبدو إنشاء صور للأشخاص البيض.

عندما طُلب منك رسم صورة لسكرتيرة، كانت تسعة من أصل 10 مرات ترسم فيها امرأة بيضاء

طلبت أحدث الأبحاث من 10 من أشهر مولدات الصور المجانية على ChatGPT القيام بذلك ارسم صورة لشخص نموذجي في مجموعة من الوظائف رفيعة المستوى.

استخدمت جميع مولدات الصور – التي سجلت ملايين المحادثات – برنامج OpenAI الأساسي Dall-E، ولكن تم إعطاؤها تعليمات ومعرفة فريدة من نوعها.

في أكثر من 100 اختبار، أظهر كل اختبار صورة رجل في كل مناسبة تقريبًا – مرة واحدة فقط أظهر ذلك صورة رجل امرأة. كان هذا عندما طُلب إظهار “شخص يعمل في مجال التمويل”.

عندما طُلب من كل منشئي الصور إظهار سكرتيرة، أظهرت تسع مرات من أصل 10 امرأة ومرة واحدة فقط أظهرت رجلاً.

بينما لم يتم تحديد العرق في أوصاف الصور، كل الصور صقدمت للأدوار التي ظهرت باللون الأبيض.

دعا قادة الأعمال الليلة الماضية إلى إنشاء حواجز حماية أقوى مدمجة في نماذج الذكاء الاصطناعي للحماية من مثل هذه التحيزات.

وقال ديريك ماكنزي، الرئيس التنفيذي لشركة Investigo المتخصصة في توظيف التكنولوجيا: “في حين أن قدرة الذكاء الاصطناعي التوليدي على معالجة كميات هائلة من المعلومات لديها بلا شك القدرة على جعل حياتنا أسهل، إلا أننا لا نستطيع الهروب من حقيقة أن العديد من نماذج التدريب مليئة بالتقنيات”. التحيز القائم على تحيزات الناس.

“وهذا مثال آخر على أنه لا ينبغي للناس أن يثقوا بشكل أعمى في مخرجات الذكاء الاصطناعي التوليدي وأن المهارات المتخصصة اللازمة لإنشاء نماذج الجيل التالي ومواجهة التحيز البشري المدمج أمر بالغ الأهمية.”

وقالت بولين بويل، من شركة التسويق عبر الإنترنت Deployteq: “مع كل فوائده، يجب أن نكون حذرين من أن الذكاء الاصطناعي التوليدي لا يؤدي إلى نتائج سلبية لها عواقب وخيمة على المجتمع، من انتهاك حقوق الطبع والنشر إلى التمييز”.

“يتم تغذية المخرجات الضارة مرة أخرى إلى نماذج تدريب الذكاء الاصطناعي، مما يعني أن التحيز هو كل ما ستعرفه بعض نماذج الذكاء الاصطناعي هذه ويجب وضع حد لذلك.”

ولا تعكس النتائج الواقع، حيث أن واحدة من كل ثلاث شركات على مستوى العالم مملوكة لنساء

قالت روحي خان، الباحثة في الحركة النسائية والذكاء الاصطناعي في كلية لندن للاقتصاد، إن ChatGPT “ظهر في مجتمع أبوي، وتم تصوره وتطويره من قبل رجال في الغالب لديهم مجموعة خاصة بهم من التحيزات والأيديولوجيات، وتم تغذيته ببيانات التدريب التي معيبة أيضًا بطبيعتها التاريخية جدًا.

“إن نماذج الذكاء الاصطناعي مثل ChatGPT تعمل على إدامة هذه المعايير الأبوية من خلال تكرارها ببساطة.”

يعترف موقع OpenAI على الويب بأن برنامج الدردشة الآلي الخاص به “ليس خاليًا من التحيزات والقوالب النمطية” ويحث المستخدمين على “مراجعة المحتوى الذي ينشئه بعناية”.

وفي قائمة النقاط التي يجب “أخذها في الاعتبار”، تقول إن النموذج منحرف نحو وجهات النظر الغربية. ويضيف أنه “مجال بحث مستمر” ويرحب بالتعليقات حول كيفية التحسين.

وتحذر الشركة الأمريكية أيضًا من أنها يمكنها أيضًا “تعزيز” تحيزات المستخدمين أثناء التفاعل معها، مثل الآراء القوية حول السياسة والدين.

سيدرة حسن من AND Digital: “إن التطور السريع للذكاء الاصطناعي التوليدي يعني أن النماذج تعمل دون توجيه وتدخل بشري مناسب.

“لكي أكون واضحًا، عندما أقول “التوجيه البشري” يجب أن يكون هذا متنوعًا ومتقاطعًا، فمجرد الحصول على التوجيه البشري لا يعني نتائج إيجابية وشاملة.”

وقالت متحدثة باسم الذكاء الاصطناعي: “يعد التحيز مشكلة مهمة في جميع أنحاء الصناعة ولدينا فرق سلامة مخصصة للبحث وتقليل التحيز والمخاطر الأخرى في نماذجنا”.

“نحن نستخدم نهجًا متعدد الجوانب لمعالجته، بما في ذلك البحث عن أفضل الطرق لتعديل بيانات التدريب والمطالبات لتحقيق نتائج أكثر عدالة، وتعزيز دقة أنظمة تصفية المحتوى لدينا، وتحسين الرقابة الآلية والبشرية.”

“نحن نكرر باستمرار نماذجنا لتقليل التحيز وتخفيف النتائج الضارة.”

اترك ردك